Le cadrage officiel donne le ton, découpé en thématiques comme Tech & AI, Startups, Cities & Climate, Creator Economy, Workplace, Design et Health : un univers construit comme un immense diagramme de Venn où tout se recoupe et où tout est en train d’être reprogrammé en même temps. La grande histoire à Austin cette année, c’est la convergence : SXSW ne traite plus la « technologie » comme un objet séparé, mais considère désormais l’innovation comme le système d’exploitation qui est en train de refactoriser, d’un seul mouvement, les business models, les systèmes urbains, le travail, les foyers, les relations, les médias, le travail humain et la vie quotidienne… Je trouve que cela a beaucoup de sens.

Amy Webb a sans doute livré jusqu’ici le coup de poing intellectuel le plus percutant. Sur scène, elle a littéralement enterré le rapport classique sur les tendances technologiques en affirmant que nous sommes arrivés à la fin de l’ère des « Top Trends for 20XX ». À la place, elle propose une grille de lecture plus dure, mais plus honnête : les Convergences, ces collisions systémiques entre technologies et changements sociaux, comme l’augmentation humaine, le travail illimité ou encore la sous-traitance émotionnelle, le tout suivi via son cadre d’analyse « Storm Tracker ». Cela capte parfaitement la tension ambiante que je ressens partout cette semaine : plus personne ne s’intéresse vraiment aux démonstrations brillantes prises isolément ; la véritable anxiété porte sur ce qui se passe lorsque l’IA devient une infrastructure pour la biologie, les soins de santé, la confiance, le travail et l’identité humaine.

Le signal est le même du côté des startups. Historiquement, le SXSW Pitch a toujours été un bon radar pour repérer les directions réelles prises par les fondateurs et les capitaux, et cette année, le concours a couronné des lauréats dans l’IA et l’IA générative, la robotique autonome, la détection des maladies, les infrastructures intelligentes et la durabilité. C’est Sotira qui a remporté le Best in Show avec sa plateforme dopée à l’IA, qui aide distributeurs, industriels et marques à écouler discrètement, monétiser et donner leurs surplus ou stocks à date courte, au lieu de les envoyer en décharge. Des gagnants comme AlterEcho.io dans la robotique, Surgicure Technologies dans la santé et GigU dans les infrastructures de smart city vont dans la même direction. Le message est d’une franchise rafraîchissante : oui, l’IA reste le principal aimant à talents et à investissements, mais la période de tolérance envers « l’IA pour l’IA » a disparu ; le travail intéressant, c’est désormais l’IA soudée à de vrais systèmes du monde réel.

Sous toute cette machinerie circule un puissant courant humain. Si l’on parcourt le programme, on voit un festival obsédé par le commerce porté par les créateurs, l’équité en santé, le futur du travail, et cette question fondamentale : les humains auront-ils encore le sentiment d’avoir de l’importance dans des systèmes de plus en plus optimisés pour les agents et l’automatisation ? Des sessions sur les entreprises de créateurs nativement construites autour de l’IA, sur les fondateurs sous-représentés dans la santé, sur le livestreaming comme moyen de subsistance, ou encore sur la psychologie du sentiment d’importance gravitent toutes autour du même centre de gravité : si l’IA devient une infrastructure invisible, comment protège-t-on le sens, l’agentivité, la confiance et la pertinence humaine à l’intérieur de cette nouvelle pile technologique ?

Voilà la musique d’ambiance qui résonne dans ma tête après cette première moitié de festival. Et puis entre en scène Brian.

Quand un ami revient avec un sac rempli de sagesse

Brian Solis n’est pas un observateur neutre dans mon histoire avec SXSW ; c’est un ami que je connais depuis longtemps, et l’une des personnes qui m’ont aidé – et toute une génération avec moi – à voir ce qu’était réellement le web social à l’époque.

Bien avant que les réseaux sociaux ne deviennent une machine publicitaire implacable, il avait écrit « The Social Media Manifesto », expliquant qu’il ne s’agissait pas d’un nouveau canal, mais d’une reconfiguration de l’influence, de la participation et du dialogue public lui-même. Sa formule de l’époque – « Social media is about sociology and anthropology, not technology » – a remarquablement bien vieilli, et de façon presque inconfortable.

Cette année, après sept ans d’absence à SXSW, Brian revient à Austin avec ce même regard d’anthropologue chirurgical, mais désormais braqué sur l’IA générative, l’intelligence augmentée, et sur ce que tout cela fait à nos cerveaux, à nos familles, à nos organisations et à nos modèles de leadership. Sa session « Augmented Intelligence and Leadership in the AI Era » a été pour moi la meilleure explication du ton général de cette première journée de festival : moins « waouh, regardez ce modèle », davantage « qu’est-ce que nous sommes en train de nous faire à nous-mêmes ? ».

Bouillie IA, darwinisme cognitif et taxe IA cachée

Brian commence avec quelque chose d’agréablement impoli pour une salle remplie de professionnels curieux de l’IA : « AI slop ». Son expression pour désigner le flot de contenus IA génériques, médiocres, copiés-collés, qui engorgent nos feeds, nos boîtes mail et nos documents internes – en particulier sur LinkedIn, où même les commentaires sentent désormais la surdose de prompts robotiques. Nous sommes, dit-il, en train de payer une « taxe IA » pour cela : les heures invisibles perdues à réécrire, corriger ou résumer une boue textuelle produite par des machines juste pour en extraire un signal utilisable (et encore souvent médiocre).

Mais la partie la plus intéressante, c’est ce que cela fait à nos têtes. En s’appuyant sur de nouvelles recherches en imagerie cérébrale et en sciences du comportement, Brian aligne tout un vocabulaire pour décrire ce qui est en train de se passer : amnésie numérique, délégation cognitive, dette cognitive, atrophie due à l’IA, cerveau frit par l’IA… Plus nous déléguons notre pensée à l’IA, plus nos propres muscles cognitifs s’affaiblissent ; plus nous acceptons les retours flatteurs et anthropomorphiques des systèmes, plus nous risquons de confondre l’appariement statistique de motifs avec la sagesse ou avec une véritable validation. Il appelle cet ensemble »darwinisme cognitive » : une lente pression de sélection, largement invisible, qui favorise celles et ceux qui externalisent leur pensée plutôt que ceux qui continuent à l’exercer, jusqu’au moment où ce décalage devient un problème.

Sa conclusion est aussi mordante que nécessaire : mal utilisée, l’IA générative mériterait sans doute des avertissements dignes des paquets de cigarettes, plutôt qu’un assistant d’onboarding jovial. Nous exportons des morceaux de notre mémoire, de notre originalité et de notre voix vers une machine, puis nous faisons comme si cette perte était un effet secondaire acceptable du fait de produire nos slides plus rapidement. C’est exactement le type de convergence que SXSW pointe depuis le début de la journée : non pas l’IA contre les humains, mais l’IA agissant sur les humains.

Faux leadership IA, vraies fractures

Brian pousse ensuite sa critique à toute vitesse jusque dans les conseils d’administration. Nous ne sommes pas seulement submergés par les contenus IA, nous sommes aussi noyés dans un « journalisme IA » et dans un faux leadership : des titres affirmant que des entreprises remplacent 40% de leurs effectifs par de l’IA, des marchés qui applaudissent, et très peu de preuves sérieuses que tout cela relève d’une refonte réfléchie plutôt que d’une simple réduction opportuniste des coûts habillée d’un mot à la mode. Quand chaque profil LinkedIn et chaque keynote de taille moyenne adoptent désormais la même voix lissée par l’IA, la soi-disant expertise devient une ambiance plutôt qu’une pratique, et la confiance organisationnelle s’érode discrètement, mais rapidement.

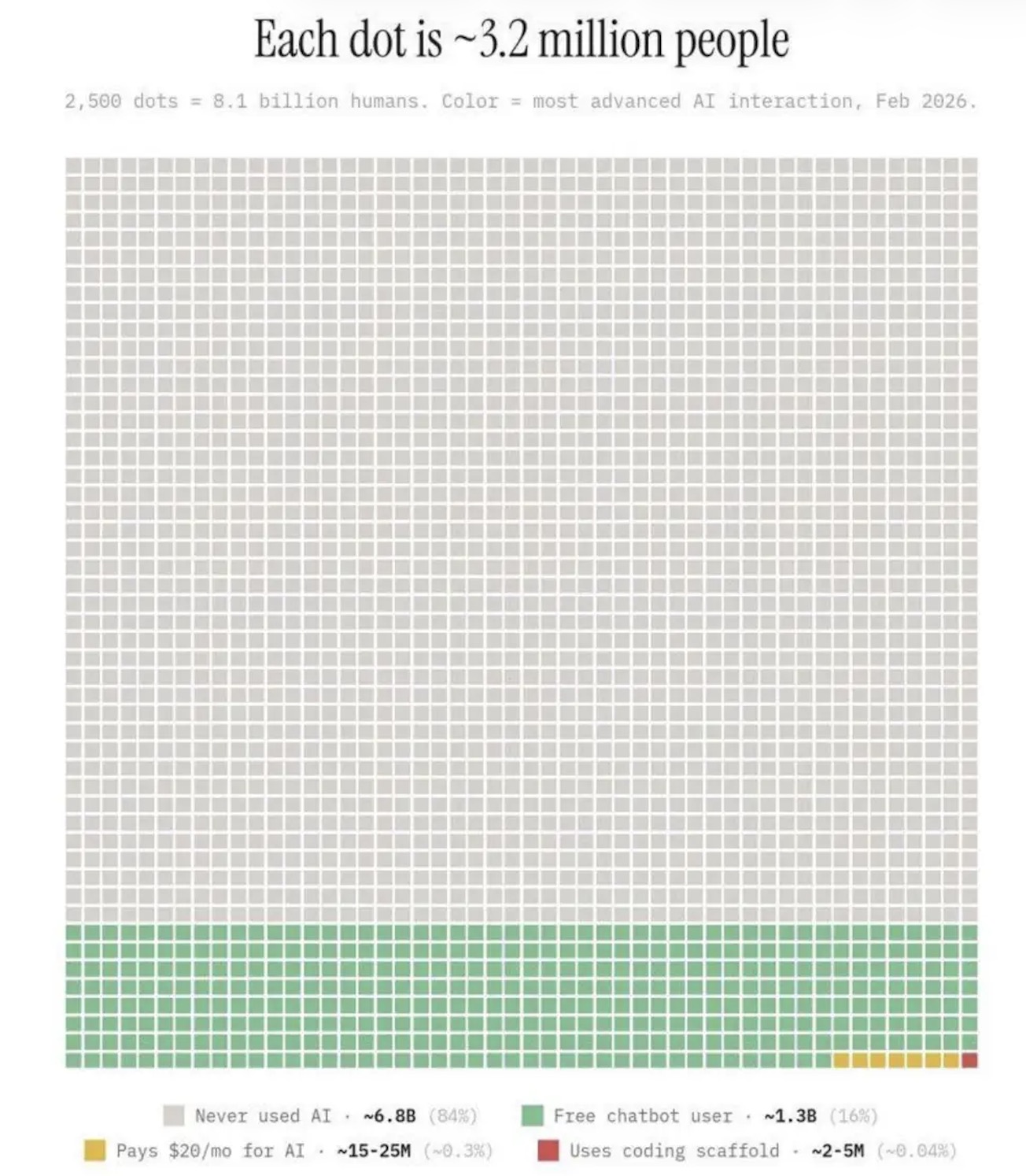

C’est là qu’il introduit l’un des schémas les plus utiles de la journée : la carte en points issue d’études récentes sur l’adoption : points gris pour les non-utilisateurs, verts pour les utilisateurs occasionnels gratuits, jaunes pour les utilisateurs avancés payants, rouges pour les builders et les codeurs.

Chaque point représentant des millions de travailleurs. Ce qui fait peur, ce n’est pas l’existence des points gris, mais plutôt que les utilisateurs jaunes, ceux qui vont loin et de manière créative avec ces outils, surperforment déjà leurs pairs verts d’un facteur sept, alors que la plupart des organisations parlent encore de « maîtrise de l’IA » comme s’il s’agissait d’une compétence uniforme et binaire. Cet écart de performance n’a rien de théorique : c’est une fracture structurelle déjà présente dans votre entreprise et sur votre marché du travail, ici et maintenant, et les dirigeants qui l’ignorent avancent en somnambules.

Sa réponse consiste à élargir ce que nous entendons par « être bon avec l’IA ». Il empile les suspects habituels – IQ, EQ (intelligence émotionnelle), SQ (agilité sociale), et cette compétence presque inexistante qu’est la véritable conscience de soi – puis il ajoute l’AIQ : le quotient d’intelligence artificielle. Mais pour Brian, l’AIQ seul (savoir prompter, savoir automatiser des tâches) ne suffit pas. Il doit fusionner dans ce qu’il appelle l’intelligence augmentée : repenser le travail de sorte que les humains continuent à faire ce qu’ils font de manière spécifiquement humaine – imaginer, empathiser, poser de meilleures questions – pendant que l’IA étend cette capacité au lieu de la remplacer.

C’est une histoire très différente de la version PowerPoint « augmenter votre workforce avec des copilots ».

Du mindset au mind shift

Brian Solis ne demande pas un changement d’état d’esprit, il demande un « mind shift » : moins affiche inspirante, davantage mise à jour du firmware. La question n’est plus « Comment utiliser l’IA pour faire plus vite ce que je fais déjà ? » mais « Qu’est-ce que je peux désormais tenter qui m’était littéralement impossible sans ces outils ? » Je pense qu’il vise juste.

Pour y parvenir, il se replonge dans l’argument classique de Sir Ken Robinson : la créativité ne s’acquiert pas au fil du temps ; c’est le système éducatif qui nous en prive, en nous récompensant pour avoir suivi les règles et en nous punissant pour nos erreurs. Aujourd’hui, la plupart des organisations mesurent fièrement l’AI proficiency et l’AI fluency – autrement dit, la capacité des collaborateurs à suivre les nouvelles règles – sans voir qu’elles n’ont fait que bâtir un statu quo automatisé. Si votre premier réflexe consiste à utiliser l’IA pour automatiser le passé, avertit Brian, alors vous vous enfermez dans un futur très limité. Vous serez extrêmement efficace à rester exactement ce que vous êtes déjà.

Son alternative repose sur un modèle à deux horizons qu’il utilise avec ses clients. Sur le premier horizon, on fait ce qui paraît évident : automatiser les tâches qui doivent réellement l’être, parce qu’elles sont répétitives et stables, et récolter les gains d’efficacité. Sur le second, on utilise délibérément l’IA pour explorer des problèmes, des prompts et des idées qu’on ne pouvait même pas aborder auparavant, en acceptant qu’une partie des résultats soit laide, et en considérant cette laideur comme le prix à payer pour l’originalité.

L’écart entre ces deux trajectoires, c’est ce qu’il appelle la disruption positive : la remise en cause de vos propres habitudes, de vos métriques et de vos modèles mentaux.

WWAID et What do you stand for?

Deux petits éléments de la session méritent particulièrement d’être mis en avant.

Le premier, c’est WWAID : « What Would AI Do? ». Avant de prompter, avant de concevoir un processus, avant d’entrer dans une décision stratégique, il faut marquer une pause et se demander : si l’intelligence était native à cet instant, si un agent disposait d’une mémoire parfaite, d’un appariement de motifs parfait, d’une patience infinite que ferait-il par défaut ?

Ensuite, on utilise cette ligne de base imaginaire comme contrepoint. Au lieu de demander la sortie la plus évidente (« résume ce rapport de marché »), on pousse l’IA à adopter des rôles qui mettent nos hypothèses à l’épreuve : être l’investisseur activiste, le futur régulateur, le client en colère, le concurrent visionnaire… La plupart des gens interagissent avec l’IA comme si c’était Google avec une meilleure grammaire. WWAID est l’astuce de Brian pour vous forcer à sortir de votre vision du monde habituelle et obtenir des prompts et des résultats que vous n’auriez jamais découverts autrement.

Le second est une question qu’il traite presque comme un système d’exploitation personnel : « What do you stand for? ». Interrogé par une personne dans le public sur la manière dont il protège sa propre voix dans un monde saturé de demandes et d’assistance IA, il propose une pratique. Régulièrement, il s’assied et réécrit ce qu’il défend, pourquoi il a commencé ce travail au départ, et quel impact il souhaite réellement avoir au-delà de la simple production plus rapide de livrables. Dans un festival qui revient sans cesse à la notion de « mattering » – ce besoin humain fondamental de se sentir valorisé et d’apporter de la valeur -, cette question n’est pas un slogan de développement personnel, c’est une compétence de survie. Si vous ne savez pas ce que vous défendez, les plateformes seront ravies de vous vendre une identité préfabriquée optimisée pour l’engagement (en rose, avec des paillettes).

Une conférence diapason

Mettez côte à côte les funérailles des rapports de tendances célébrées par Amy Webb et l’autopsie de l’AI slop proposée par Brian Solis, et vous obtenez une carte assez précise de SXSW Innovation 2026 jusqu’ici.

D’un côté, une futurologue nous dit d’arrêter de fétichiser les tendances isolées et de commencer à suivre les convergences, à l’échelle des systèmes, comme l’augmentation humaine, le travail illimité et la sous-traitance émotionnelle. De l’autre, un ami anthropologue du numérique revient à SXSW pour montrer comment ces convergences se déploient déjà à l’intérieur même de notre connaissance, de nos feeds, de nos organisations et de nos habitudes de leadership.

C’est pour cela que sa session m’a semblé être le diapason de cette première moitié du festival. Elle expliquait pourquoi tant d’autres sessions revenaient sans cesse vers le même malaise : l’IA non pas seulement comme couche de productivité, mais comme force invisible agissant sur la confiance, la créativité, le sentiment d’importance et les récits que nous nous racontons à nous-mêmes pour nous sentir utiles dans un monde d’agents et d’usines automatisées.

Brian ne plaide pas pour moins d’IA. Il plaide pour moins de paresse : moins d’ AI slop, moins d’automatisation non examinée du passé, et beaucoup plus d’intelligence augmentée, construite délibérément sur l’empathie, la curiosité, la créativité, et sur une réponse brutalement honnête à cette question toute simple:

Que défendez-vous ?